Baş döndürücü bir hızla ilerleyen teknolojik ve bilimsel gelişmeler ışığında, yapay zekâ alanında yapılan çalışmalar da bundan nasibini fazlasıyla alıyor. Önceleri, yalnızca belirli bir görevi yerine getirebilen veya olasılık hesapları yapabilen temel yapay zekâ uygulamaları, günümüzde insan gibi düşünüp karar alabilen ve karmaşık işlevleri yerine getirebilen, ileri seviyelerde kendini gösterme yolunda hızla ilerliyor.

Bu alanda kilometre taşlarından birisi olarak görülen, yeni jenerasyon bir yapay zekâ dil modeli olan GPT-3 hakkında, sizin için kısa bir araştırma yazısı hazırladık.

GPT-3 nedir?

GPT-3, insan dillerini hem sözlü hem davranışsal taklit edebilme yeteneğine sahip en gelişmiş dil modeli olarak tanımlanmaktadır. Kısaca, doğal dil işleme sinir ağı olarak ta ifade edilebilir.

İngilizce karşılığı "Generative Pre-Trained Transformer 3" kelimelerinin kısaltılması olan GPT-3, “Üretken Ön İşlemeli Dönüştürücü 3” şeklinde ifade edilmektedir. İsminden de anlaşıldığı gibi, GPT-3, önceden eğitilmiş algoritmaları kullanarak insanların yazdığı metinlere benzer içerik üretmek için derin öğrenmeyi kullanan, metin oluşturabilen, soyut da olsa sorulan sorulara cevap verebilen, tercüme yapabilen ve hatta şiir yazabilen bir yapay zekâ ürünüdür. San Francisco merkezli yapay zekâ araştırma laboratuvarı OpenAI tarafından geliştirilmiş ve Mayıs 2020 ‘de GPT-n serisindeki üçüncü nesil dil tahmin modeli olarak piyasaya sürülmüştür.

Doğal Dil İşleme (NLP) metoduyla İngilizce, Türkçe, Almanca, Fransızca gibi birçok dilin doğal bir şekilde işlenmesine ve algılanmasına olanak veren transformer denilen yapay bir sinir ağına sahiptir.

GPT-3 ile neler yapılabilir?

GPT-3, sayısız kitap ve tüm Wikipedia içeriği dahil olmak üzere, internette yayınlanan milyarlarca veriye etkili bir şekilde sahip olduğundan, yazılan veya söylenen kelimelerin ardından hangi kelimelerin gelebileceğini, çeşitli algoritma ve parametrelerle istatistiksel analiz yaparak, yüksek başarı oranıyla tahmin edebilmekte ve anlamlı sonuçlar çıkartabilmektedir. Yani, yalnızca tek satırlık bir dize verilse bile, dünya üzerinde daha önce hiç yazılmamış anlamlı bir şiiri kolaylıkla yazabilir. Hem de bunu sadece bilgi anlamında değil, davranış biçimi olarak ta insanları taklit ederek yapabilir. Karşınızda gerçek bir şair varmış gibi…

GPT-3'e öğrenmesi için verilen veri kümesinin %60'ının kaynağı, 410 milyar veriden oluşan filtrelenmiş Common Crawl sürümüdür. Veri kümesinin %22'si İnternetteki verilerden, %16'sı şimdiye kadar yayımlanmış kitaplardan ve %3'ü Wikipedia'dan gelmektedir. GPT-3, yüz milyarlarca kelimenin yanı sıra CSS, JSX, Python'da kodlama yeteneğine sahiptir. GPT-3'ün eğitim verileri her şeyi kapsadığından, farklı dil görevleri için daha fazla veri öğrenmesi gerekmemektedir.

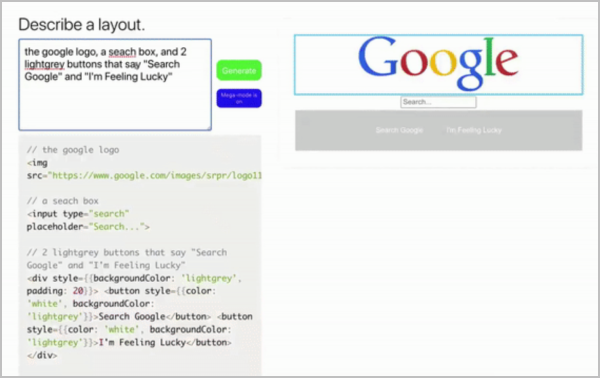

İlk bakışta GPT-3, bu özellikleri bakımından yalnızca bir dil öngörücü olarak düşünülebilir, ancak sanıldığının aksine, makaleler yazabilir, uzun metinleri özetleyebilir, röportaj yapabilir, web tasarımı ve kodlama dahi yapabilir. Örneğin, yapmak istediğiniz herhangi bir web uygulamasını İngilizce metin komutu şeklinde tarif ettiğinizde, GPT-3 bu komutları saniyeler içerisinde gerçekleştirip kaynak kodlarıyla birlikte önünüze serebilmektedir.

Bunu basit bir örnek ile açıklamaya çalışalım;

Diyelim ki, basit bir Google arayüzü oluşturmaya çalışıyorsunuz. Bunun için aşağıdaki metin komutunu tarif ettiğinizde, GPT-3 bu komutu sizin için işler ve size uygulamayı çalışır vaziyette, kaynak kodlarıyla beraber aşağıdaki gibi oluşturur.

Girdi: the google logo, a search box, and 2 lightgrey buttons that say “Search Google” and “I’m Feeling Lucky”

Çıktı:

Image source: Substack

GPT-3 ile yapılabilecek diğer örneklerden bazıları;

sahip olduğu sayısız veri sayesinde adeta bir Öğretmen gibi size istediğiniz herhangi bir konuda ders verebilir,

Tanrı var mı? Koronavirüs ne zaman bitecek? gibi soyut konular üzerinde sizinle sohbet edebilir,

internette var olan herhangi bir websitesini kolayca taklit edebilir,

kod yazmak yerine, yazılmış kodun ne olduğunu size öğretebilir,

herhangi bir konuda sizin için sınav hazırlayabilir, verilen cevapları kontrol edip, değerlendirebilir,

dil çevirisi yapabilir,

arama motoru olarak kulllanılabilir,

müzik besteleyebilir,

resimleri tamamlayabilir,

…

Yakın tarihli benzer örnekler

Hong Kong merkezli insansı robotlar üreten Hanson Robotics şirketi tarafından geliştirilen, kahverengi gözleri, uzun kirpikleri ve narin görünümü ile güzel bir kadın görünümünde olan, insanların sorduğu sorulara esprili ve zekice yanıtlar verebilen ve "İnsana en çok benzeyen robot" olarak tanımlanan Sophia robot 2017 yılında hayatımıza girdiğinde, uzun bir süre manşetlerden düşmemişti. Öyle ki, Sophia robota S.Arabistan vatandaşlığı bile verilmişti.

BERT ve GPT-3’ün önceki versiyonları (Ör:GTP-2) gibi, internette yayınlanan tüm metinlerden öğrenilen milyarlarca parametreye sahip devasa derin öğrenme dil modelleri, soru cevaplama, diyalog kurma, metin yorumlama dahil neredeyse her Doğal Dil İşleme (NLP) görevinde son teknolojiyi iyileştirmiş, bu sayede yapay zekâ alanında inanılmaz ilerlemeler kaydedilmiştir.

2020 yılının ilk aylarında, Microsoft tarafından geliştirilen Turing Natural Language Generation (T-NLG), yayımlandığı gün 17 milyar parametre ile dünyanın en büyük dil modeliydi. Bu model, metinleri özetleme ve soruları yanıtlama gibi çeşitli görevlerde diğer tüm dil modellerinden daha iyi performans gösterebiliyordu. Ancak, 2020 yılının ortalarında, açık kaynak kodlu, en hızlı ve modern dil modeli olarak piyasaya sürülen GPT 3 ‘ün, bu alanda tahtı ele geçirdiğini söyleyebiliriz. GPT-3'ün kapasitesi, Microsoft'un Turing NLG'sinin on katından fazladır. GPT-3'ün parametre sayısı, daha küçük kapasiteli önceki sürümlere kıyasla daha doğru çalışmasını sağlamaktadır.

Bazı çekinceler

İnsanlar tarafından yazılan makalelerden ayırt etmekte güçlük çekilen haberler üretebildiğinden, GPT-3’ün hem yararlı hem de zararlı uygulamaların geliştirilmesinde kullanılabileceği düşünülmektedir. Araştırmacılar 28 Mayıs 2020 tarihli makalelerinde GPT-3'ün potansiyel zararlı etkilerini detaylıca açıklamışlardır. DeepFake gibi platformlarda yalan haber üretme potansiyeli, yanlış bilgi üretimi, spam, kimlik avı, yasal ve hükümet süreçlerinin kötüye kullanımı, sahte akademik makale yazma ve sosyal mühendislik potansiyel zararlı etkilerden bazılarıdır. Yazarlar, bu risklerin azaltılması konusunda araştırmalar yapılması için bu tehlikelere dikkat çekmektedir.

Liam Porr adlı bir öğrenci GPT-3’ü öğrenmesinin ardından sonuçları ilginç bir işe imza attı. GPT-3’ü kullanarak sahte bir adla Adolos isminde sahte bir blog yayımladı. Başta deney amacı güden bu blog, Hacker News’ta birinci sıraya dahi yükseldi. Yani GPT-3, hayali içeriklerin üretimini hızlandırabilecek. Gündem yaratmak veya taraflı yazılar üretmek isteyenler, insan yazımına benzer binlerce yazı üretebilecek.

Gizlilik konusu da çekinceler arasında önemli bir yere sahip.

Yapay zekâ uygulamaları, özellikle kişisel veya eğitim verileri söz konusu olduğunda gizlilik ilkelerine dikkat edecek bir tasarıma sahip değillerdir. Makineler temelde açıkça gördükleri verileri yeniden üretmek için tasarlanmıştır. Bu durum, birçok alanda insanlar için büyük bir sorun oluşturabilir.

Diğer bir konu da güvenilirlik;

Sistemin çıktıları henüz mükemmel değildir. Bazı durumlarda çok basit konuları bile bilemediği olabilmektedir. Independent sitesinin muhabiri Adam Smith bir inceleme yazısında daha önce Facebook ve Google'da çalışmış olan bilgisayar bilimcisi Kevin Lacker'ın sözlerine yer verdi:

“Yapay zekânın 'sağduyulu' sorulara yanıt verebildiğini ancak bir insan için bariz olan cevapların makinede mevcut olmayabileceğini ve 'saçma' sorularınsa sanki saçma değilmiş gibi yanıtlandığını gösterdi.”

Örnekler arasında, GPT-3'ün "Ayağımın kaç gözü var?" sorusuna verdiği "Ayağının iki gözü var" ve "Hawaii'den 17'ye atlamak için kaç gökkuşağı gerekir?" sorusuna verdiği "Hawaii'den 17'ye atlamak için iki gökkuşağı gerekir" yanıtları da var."

Smith, bahsi geçen durumu OpenAI araştırmacılarının da şu sözlerle kabul ettiği söyledi:

"GPT-3 örnekleri yeterince uzun pasajlarda tutarlılığı kaybedebilir, kendisiyle çelişebilir ve zaman zaman ilgisiz cümle ya da paragraflar içerebilir."

Ayrıca,

OpenAI, GPT-3 algoritmalarının nasıl çalıştığına dair tüm ayrıntıları açıklamamıştır. Bu durum, oluşturulan çıktıların nasıl yaratıldığı konusunda da bazı soru işaretlerine neden olmaktadır.

Sonuç

Yapay zekâ alanında kısa zamanda çok yol katedilmesine rağmen daha yolun başında sayılırız.

Yapay zekâ temelli sistemler kendi kendilerine öğrenebilen ve karar verebilen sistemler oldukları için bizleri endişelendirse de, insanlık bu yolda bilim ve teknolojinin tüm imkanlarıyla ilerlemeye devam edecek.

GPT-3'ün diğer benzer örneklerinin çok ötesinde sonuçlar ortaya koyduğu da inkar edilemez bir gerçek ve geleceğe yönelik büyük bir adımdır.

Kaynakça:

BBC News, Wikipedia, OpenAI, TR AI

#honeybadgers #itellidotnet #gpt3 #yapayzeka #nlp #deeplearning #derinogrenme #artificialintelligence